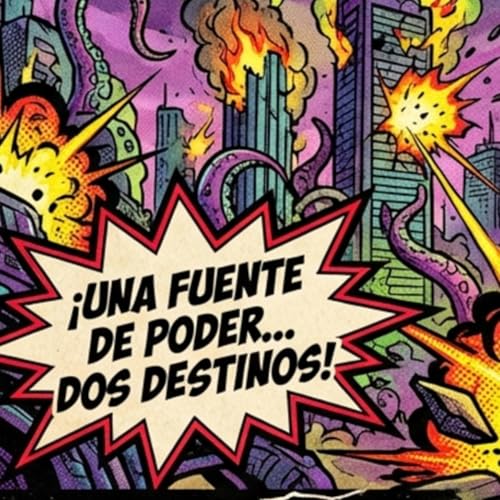

En este vídeo analizamos a fondo el choque histórico entre Anthropic, la empresa detrás de Claude, y el Departamento de Guerra de Estados Unidos.¿Qué pasó para que un socio clave del Pentágono, con un contrato de hasta 200 millones de dólares, acabara siendo etiquetado como “riesgo de cadena de suministro”? ¿Por qué Anthropic se niega a permitir que su IA se use en vigilancia masiva de ciudadanos estadounidenses y en sistemas de armas totalmente autónomas, y qué significa realmente la exigencia de “todos los usos legales”?Reconstruimos la cronología completa: la integración de Claude en redes clasificadas a través de Palantir, su papel en operaciones reales como la ofensiva contra Nicolás Maduro en Venezuela, las reuniones de alto nivel en el Pentágono y el ultimátum respaldado por la Defense Production Act. Verás cómo se usa una IA de chat en inteligencia militar, planificación operativa y selección de objetivos, y dónde se difumina la línea entre “apoyo a la decisión” y “arma autónoma”.También exploramos la dimensión ética, legal y geopolítica: las directivas del Departamento de Defensa sobre armas autónomas, el debate internacional sobre “killer robots”, la politización del caso por parte de la administración Trump y las implicaciones para otros laboratorios de IA como OpenAI, Google o xAI. Finalmente, planteamos escenarios a 5–10 años: desde una militarización sin frenos de la IA hasta la aparición de normas internacionales que prohíban sistemas capaces de matar sin control humano significativo.Si te interesa la intersección entre IA, ciberseguridad, geopolítica y el complejo militar‑industrial, este es tu vídeo.

14 分

14 分 13 分

13 分 6 分

6 分 6 分

6 分 5 分

5 分 20 分

20 分 8 分

8 分 8 分

8 分